本地部署的意义

不联网

随时可用

部署私有知识库

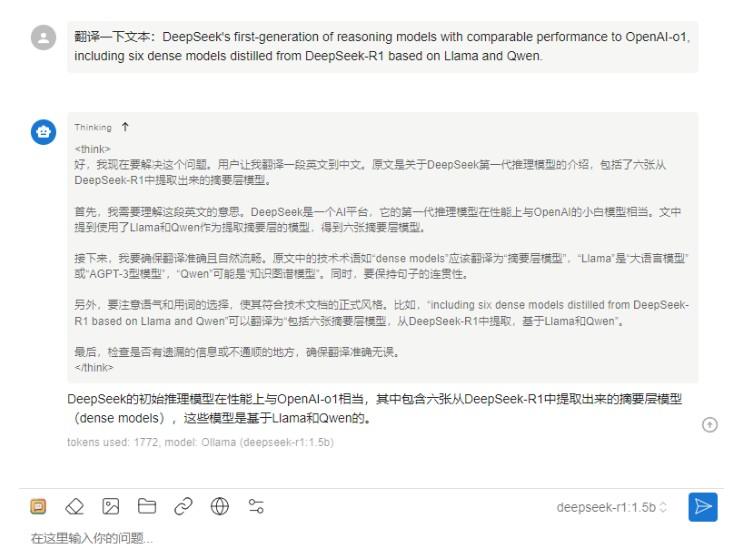

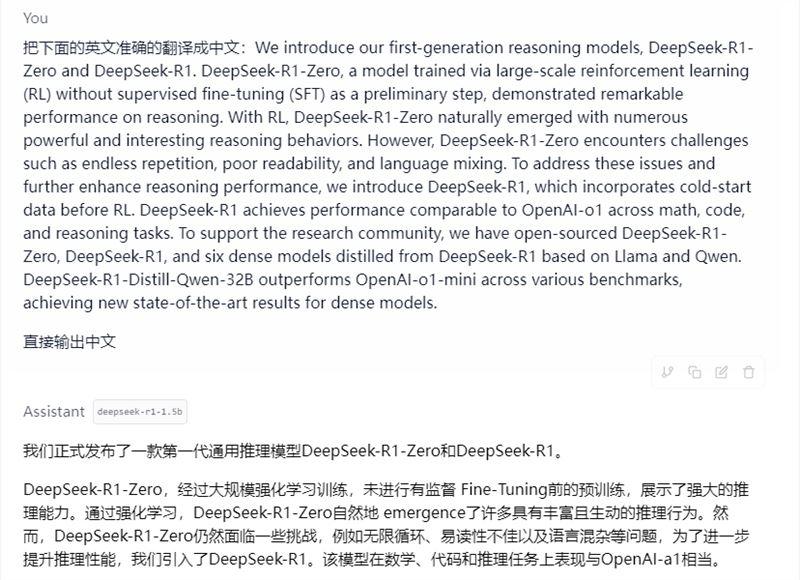

个人觉得下个小模型当作翻译器还是很不错的,而且最近在线的老奔溃

本地部署的缺点

本地用不了满血版的

安装稍微麻烦一点

比较占内存

我这里也是搜集了一些主流的部署方法

本地部署方法一

一、下载 Ollama

下载地址:https://ollama.com/

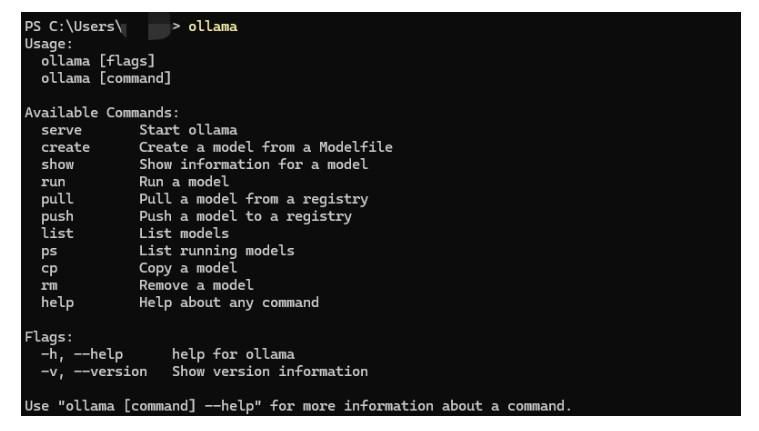

无需注册,安装成功后在命令行输入 ollama 查看是否安装成功

二、下载模型

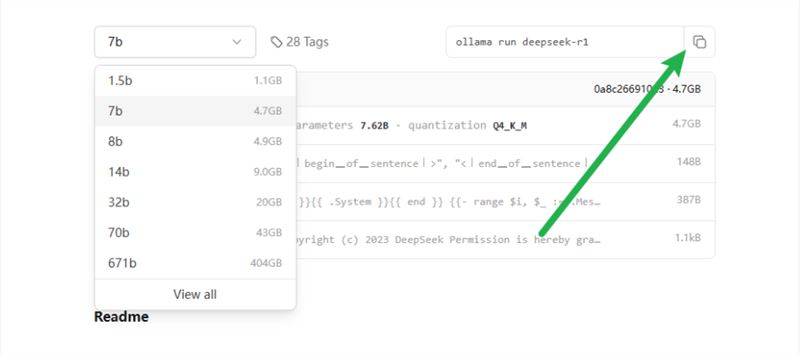

下载地址:https://ollama.com/library/deepseek-r1

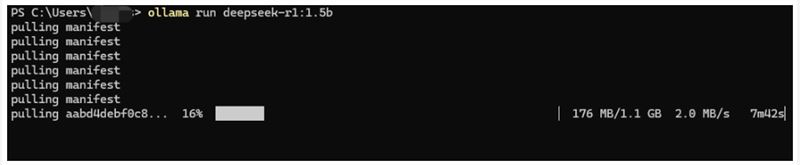

ollama 内置了很多量化后的模型,大家选择一个适合自己的然后复制命令到命令行运行即可,我这里以 1.5b 为例

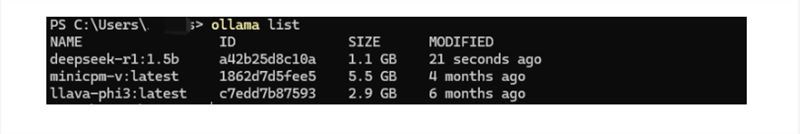

下载完我们可以在命令行输入:ollama list 查看已经安装的模型

三、下载 Chatbox AI

Chatbox AI 是一个 AI 客户端应用程序和智能助手。兼容许多尖端的 AI 模型和 API。

然后我们打开设置——模型

在模型提供方选择 ollama api,然后选择刚刚下载的 1.5b 模型就可以了

本地部署方法二

另一个主流的AI 客户端是 LM Studio,下载地址:https://lmstudio.ai/

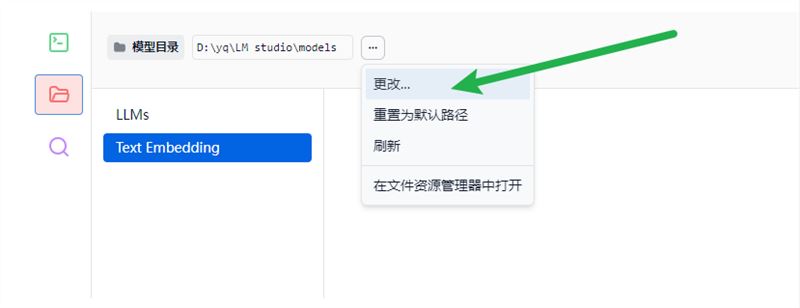

默认模型目录在 C 盘,所以推荐安装完先修改一下存放模型的路径

然后我们去 huggingface 上下载量化模型:

https://huggingface.co/collections/unsloth/deepseek-r1-all-versions-678e1c48f5d2fce87892ace5

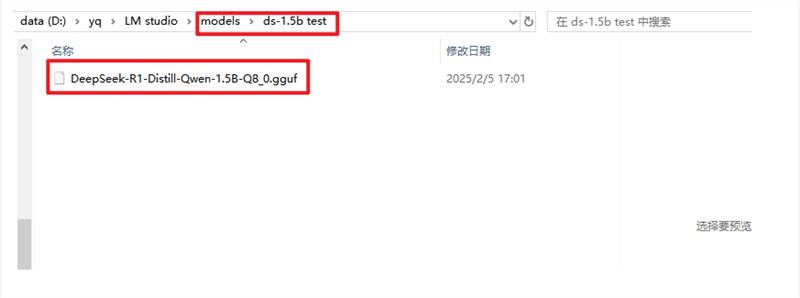

我这里下载的 1.5b 的 Q8 模型进行演示,下载完我们就放到文件夹内

⚠️注意:我们的目录一定要按:models/文件夹 1/文件夹 2/大模型.gguf

大模型外面套两个文件夹的这个顺序,不然 LM 识别不到模型

比如下方就是错误的

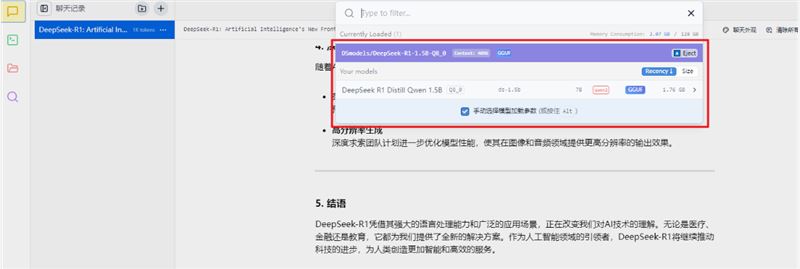

然后我们这 LM 就可以识别到大模型了

我们再回到聊天框就可以加载模型了

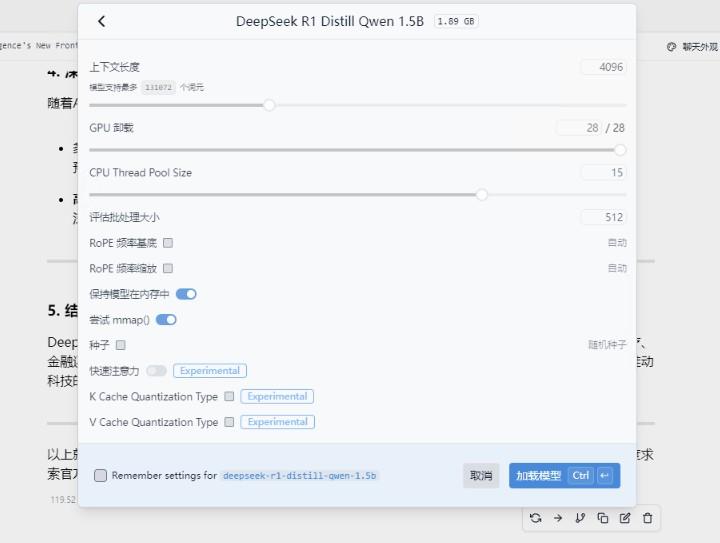

加载时需要对模型进行一些设置,这些设置可以影响模型的性能和速度,一般默认即可

速度比Chatbox AI 的更快

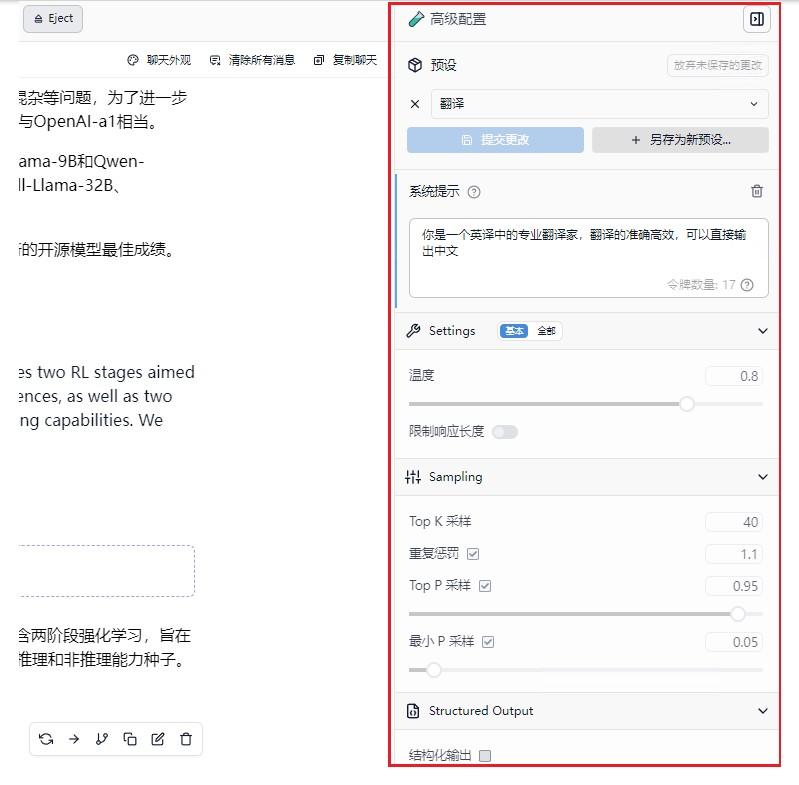

此外边上的高级配置也非常有用,可以预设角色,温度,响应长度等等

相比 chatboxai 会更专业一点

最后

提醒一下年后很多机构打着 DeepSeek 的旗号到处割韭菜,大家没必要去花那些钱,很多教程网上都有。AI 只是一个工具,具体怎么用还得看个人实际情况。